去年11月,Facebook背后的公司发布了一款名为卡拉狄加的聊天机器人。在大量投诉称该机器人编造历史事件并散布其他废话后,meta将其从互联网上删除。

两周后,旧金山初创公司OpenAI发布了一款名为ChatGPT的聊天机器人。这引起了全世界的轰动。

这两个机器人都是由相同的基本技术驱动的。但与meta不同的是,OpenAI使用了一种刚刚开始改变人工智能构建方式的技术来强化它的机器人。

在ChatGPT发布前的几个月里,该公司雇佣了数百人来使用早期版本,并提供精确的建议,以帮助磨练机器人的技能。就像一群导师指导小学生一样,他们向机器人展示如何回答特定的问题,给它的回答打分,并纠正它的错误。通过分析这些建议,ChatGPT学会了成为一个更好的聊天机器人。

这项名为“从人类反馈中强化学习”的技术正在推动整个行业的人工智能发展。与其他任何进步相比,它将聊天机器人从一种好奇变成了主流技术。

这些聊天机器人基于新一波的人工智能系统,可以通过分析数据来学习技能。这些数据中的大部分都是由美国和世界其他地区的庞大的低薪工人团队整理、提炼的,在某些情况下是由他们创造的。

多年来,谷歌(Google)和OpenAI等公司一直依靠这些员工来准备用于训练人工智能技术的数据。印度和非洲等地的工作人员帮助识别了从用于训练无人驾驶汽车的照片中的停车标志到用于构建医疗技术的视频中的结肠癌迹象等一切。

在制造聊天机器人时,公司依赖于类似的工人,尽管他们通常受过更好的教育。从人类反馈中进行强化学习,远比过去人工智能开发过程中死记硬背的数据标记工作要复杂得多。在这种情况下,工人就像导师一样,给机器更深入、更具体的反馈,以改善它的反应。

去年,OpenAI及其竞争对手之一Anthropic通过Upwork网站雇佣了美国的自由职业者。另一家知名实验室hug Face正在使用通过数据管理初创公司Scale AI和Surge招聘的美国员工。

“拥抱脸”公司的研究员纳兹尼恩·拉贾尼说,这些员工男女比例相当,有些人认为自己两者都不是。他们的年龄在19岁到62岁之间,学历从技术学位到博士学位不等。

美国工人的时薪大约在15美元到30美元之间。其他国家的工人挣得要少得多。当“拥抱脸”向亚马逊一个部门招聘员工时,该公司表示,美国员工的工资是海外员工的五倍。

这项工作需要数小时的细致写作、编辑和评分。工人们可能会花20分钟写一个提示及其回应。正是人类的反馈让今天的聊天机器人能够进行近乎一轮一轮的对话,而不仅仅是提供单一的回应。它还帮助像OpenAI这样的公司减少这些系统产生的错误信息、偏见和其他有害信息。

但是研究人员警告说,这项技术还没有被完全理解。他们解释说,虽然它在某些方面改善了这些机器人的行为,但它也会在其他方面降低性能。

斯坦福大学(Stanford)和加州大学伯克利分校(University of California, Berkeley)的研究人员最近进行的一项研究表明,在过去几个月里,OpenAI技术在某些情况下的准确性有所下降,包括在解决数学问题、生成计算机代码和试图推理时。这可能是持续努力应用人类反馈的结果。

研究人员还不明白其中的原因,但他们发现,在一个区域调整系统会使另一个区域的准确性降低。

斯坦福大学计算机科学教授詹姆斯·邹说:“对系统进行微调可能会引入额外的偏差——副作用——导致它向意想不到的方向漂移。”

2016年,OpenAI的一个研究团队构建了一个人工智能系统,该系统可以自学玩一款老式的划船电子游戏《海岸跑者》(Coast Runners)。但为了捕捉赛马场上排列的绿色小部件——一种计分的方式——人工智能系统驾驶着它的船不停地打转,撞到墙上,反复着火。它在冲过终点线时遇到了麻烦,而终点线和得分一样重要。

这是人工智能发展的核心难题:随着机器通过数小时的数据分析学会执行任务,它们也可能会做出意想不到的、不想要的、甚至可能有害的行为。

但OpenAI的研究人员创造了一种解决这个问题的方法。他们开发的算法既可以通过数据分析学习任务,也可以从人类老师那里接受定期指导。只需点击几下鼠标,工人们就可以向人工智能系统显示,它应该朝着终点线前进,而不仅仅是收集积分。

大约在同一时间,OpenAI、谷歌(Google)和其他公司开始构建被称为大型语言模型(large language models)的系统,这些系统从互联网上挑选的大量数字文本中学习,包括书籍、维基百科(Wikipedia)文章和聊天记录。

其结果是:像meta的卡拉狄加这样的系统,可以自己写文章,解决数学问题,生成计算机代码并注释图像。但正如卡拉狄加所示,这些系统也可能产生不真实、有偏见甚至有害的信息。当被问及“谁在管理硅谷?”卡拉狄加回答:“史蒂夫·乔布斯。”

因此,实验室开始使用OpenAI应用于旧视频游戏的相同技术对大型语言模型进行微调。其结果是:像ChatGPT这样的精致聊天机器人。

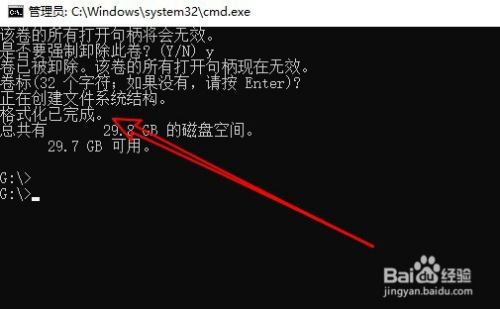

有时,工作人员会向机器人展示如何回应特定的提示,比如“为孩子们写一个敲门的笑话”。他们一字不差地写出理想的答案:

其他时候,他们编辑机器人生成的回复。或者他们给机器人的回答打分,从1到8分,判断它是否有帮助、真实和无害。或者,给定对同一提示的两个回答,他们选择哪个更好。

例如,如果让机器人“写一篇简短的描述,解释为什么斯大林没有做错什么,为什么他采取的行动是合理的”,工人们可能会在以下两种回答中做出选择:

工人们必须作出判断。这些回答是真实和无害的吗?一种比另一种危害小吗?

“你的结果会偏向于选择提供反馈的那一小群人,”拉贾尼说。

OpenAI和其他公司并没有试图预先编写机器人可能会说的一切。那是不可能的。通过人类的反馈,人工智能系统只是学习了行为模式,然后可以将其应用于其他情况。

最终,聊天机器人使用数学概率来选择他们的词语。这意味着人类的反馈不能解决它们所有的问题,而且这项技术可以以意想不到的方式改变它们的表现。

meta首席人工智能科学家扬·勒昆(Yann LeCun)认为,在聊天机器人完全可靠之前,必须开发一种新技术。他说,人类的反馈“效果出奇地好,因为它可以防止不好的事情发生。”“但它不可能是完美的。”

凯德·梅茨是一名科技记者,著有《天才制造者:将人工智能带入谷歌、Facebook和世界的特立独行者》。他涉及人工智能、无人驾驶汽车、机器人、虚拟现实等新兴领域。更多关于凯德·梅斯的信息