10个多月前,OpenAI的ChatGPT首次向公众发布。它的到来开启了一个关于人工智能的头条新闻层出不穷的时代,并加速了谷歌、meta和其他科技巨头竞争大型语言模型(llm)的发展。从那时起,这些聊天机器人展示了令人印象深刻的生成文本和代码的能力,尽管并不总是准确的。现在,不仅能够解析文本,还能够解析图像、音频等的多模态人工智能正在兴起。

上周,OpenAI首次向付费用户发布了由LLM GPT-4驱动的ChatGPT多模式版本,距离该公司首次宣布这些功能已有几个月。早在今年5月,谷歌就开始将与新款GPT-4类似的图像和音频功能整合到其基于llm的聊天机器人Bard的某些版本中。今年春天,meta也宣布在多模式方面取得了重大进展。尽管这项新兴技术还处于起步阶段,但它可以执行各种任务。

《科学美国人》测试了两种依赖于多模态llm的聊天机器人:一种是由升级版GPT-4(被称为GPT-4带视觉,或GPT-4V)驱动的聊天机器人,另一种是由谷歌的PaLM 2模型驱动的Bard。两者都可以进行免提语音对话,只使用音频,它们可以描述图像中的场景,并破译图片中的文本行。

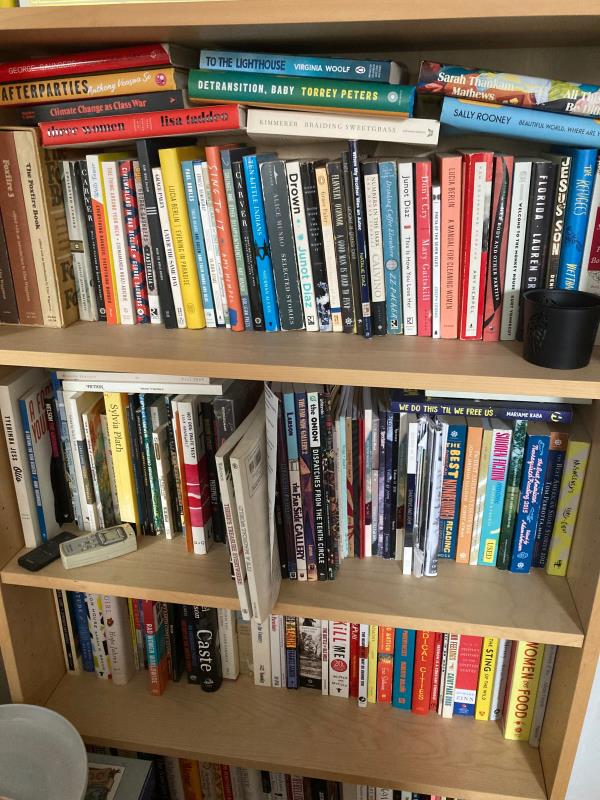

这些能力有无数的应用。在我们的测试中,只使用一张收据的照片和两行提示,ChatGPT准确地分割了一个复杂的酒吧标签,并计算出四个人每人欠的金额——包括小费和税。总的来说,这项任务只用了不到30秒。巴德做得几乎一样好,但它把一个“9”解释为“0”,从而搞砸了最终的总数。在另一项试验中,当给出一张摆满书架的照片时,两个聊天机器人都提供了对假想主人的性格和兴趣的详细描述,几乎就像人工智能生成的星座。两者都从一张照片中认出了自由女神像,推断出这张照片是在曼哈顿下城的一间办公室里拍摄的,并提供了从摄影师原来的位置到地标的准确方向(尽管ChatGPT的指导比巴德的更详细)。ChatGPT在从照片中准确识别昆虫方面也优于巴德。

对于残疾人社区来说,这种技术的应用尤其令人兴奋。今年3月,OpenAI开始通过Be My Eyes公司测试其GPT-4的多模式版本,该公司通过一款同名应用程序为盲人和弱视人群提供免费的描述服务。早期的测试非常顺利,现在Be My Eyes正在向所有用户推出人工智能版本的应用程序。Be My Eyes的首席技术官杰斯珀?亨里克森(Jesper Hvirring Henriksen)表示:“我们得到了如此特别的反馈。一开始存在许多明显的问题,例如文本转录不佳或包含AI幻觉的不准确描述。Henriksen说OpenAI已经改进了这些最初的缺点,但是错误仍然存在,但不太常见。因此,“人们都在谈论重获独立,”他说。

在这波聊天机器人的新浪潮中,这些工具超越了语言。然而,它们仍然是基于基于语言的人工智能模型。这怎么可能呢?尽管个别公司不愿分享其模型的确切基础,但这些公司并不是唯一致力于多模式人工智能的团体。其他人工智能研究人员对幕后发生的事情有很好的了解。

斯坦福大学(Stanford University)教授机器学习课程的兼职教授、Contextual AI公司的首席执行官杜威?基拉(Douwe Kiela)表示,从纯文本的法学硕士到能够对视觉和音频提示做出反应的人工智能,主要有两种方式。Kiela解释说,在更基本的方法中,人工智能模型基本上是堆叠在一起的。用户向聊天机器人输入一张图片,但图片会通过一个单独的人工智能进行过滤,该人工智能专门为生成详细的图片说明而设计。(谷歌多年来一直有这样的算法。)然后将文本描述反馈给聊天机器人,聊天机器人对翻译后的提示作出响应。

相反,“另一种方式是更紧密的耦合,”Kiela说。计算机工程师可以通过结合每个模型背后的计算机代码基础设施,将一种人工智能算法的片段插入另一种算法。根据Kiela的说法,这“有点像把一棵树的一部分嫁接到另一个树干上。”从那里,移植的模型在多媒体数据集上重新训练,包括图片、带有字幕的图像和文字描述,直到人工智能吸收了足够的模式,能够准确地将视觉表示和文字联系在一起。这比第一种策略需要更多的资源,但它可以产生更强大的AI。Kiela的理论是,谷歌对Bard使用了第一种方法,而OpenAI可能依赖于第二种方法来创建GPT-4。这个想法可能解释了两种模型在功能上的差异。

不管开发者如何将不同的AI模型融合在一起,从本质上看,都是相同的过程。llm的基本功能是预测短语中的下一个单词或音节。要做到这一点,它们依赖于“转换器”体系结构(GPT中的“T”)。卡耐基梅隆大学(Carnegie Mellon University)的计算机科学家鲁斯兰·萨拉赫丁诺夫(Ruslan Salakhutdinov)说,这种类型的神经网络将诸如书面句子之类的东西转化为一系列以向量表示的数学关系。对于一个变形神经网络来说,一个句子不仅仅是一串单词——它是一个映射上下文的连接网络。这就产生了更多类似人类的机器人,它们可以处理多种含义,遵循语法规则并模仿风格。为了组合或堆叠人工智能模型,算法必须在输出路径上将不同的输入(无论是视觉、音频还是文本)转换为相同类型的矢量数据。Salakhutdinov说,在某种程度上,它需要两组代码并“教它们相互交谈”。反过来,人类用户可以用新的方式与这些机器人交谈。

许多研究人员将当下视为可能的开端。一旦你开始调整、整合和改进不同类型的人工智能,快速的进步必然会不断到来。Kiela设想在不久的将来,机器学习模型可以轻松地响应、分析和生成视频甚至气味。Salakhutdinov猜测,“在未来5到10年内,你将拥有自己的个人人工智能助手。”这样的程序将能够在收到一个简短的提示后导航从完整的客户服务电话到复杂的研究任务。

多模态人工智能与通用人工智能不同,通用人工智能是机器学习领域的圣杯,计算机模型超越了人类的智力和能力。然而,斯坦福大学(Stanford University)的计算机科学家詹姆斯·邹(James Zou)表示,多模式人工智能是朝着这个目标迈出的“重要一步”。人类有一系列相互交织的感官,我们通过这些感官来理解世界。据推测,要达到通用人工智能,计算机也需要同样的条件。

邹说,尽管多模式模式令人印象深刻,令人兴奋,但与它们单一的前辈一样,它们也存在许多同样的问题。“最大的挑战是幻觉问题,”他指出。如果人工智能助手随时都可能伪造信息,我们怎么能相信它呢?接下来是隐私问题。有了语音和视觉等信息密集的输入,甚至更敏感的信息可能会在无意中被送入机器人,然后在泄露或黑客攻击中被反刍。

邹仍然建议人们仔细尝试这些工具。他说:“把你的医疗记录直接输入聊天机器人可能不是个好主意。”